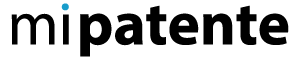

Xalapa, Veracruz. (Agencia Informativa Conacyt).- La Universidad Veracruzana, a través del Centro de Investigación en Inteligencia Artificial (CIIA), desarrolla un sistema que ayudaría a la traducción del lenguaje de señas, utilizado por las personas con discapacidad auditiva. Se trata de un método de reconocimiento de imágenes, que se apoya en un sensor MS-Kinect, para traducir señas a texto.

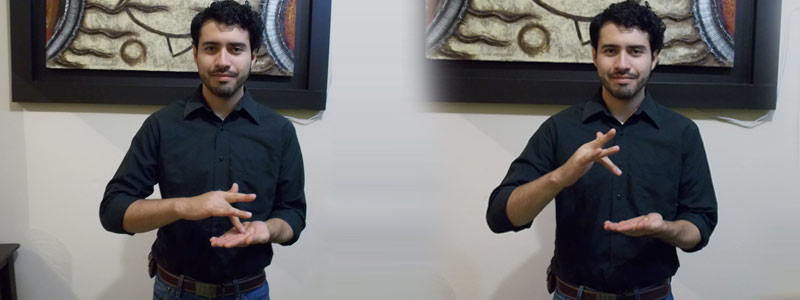

De acuerdo con el doctor Homero Vladimir Ríos Figueroa, investigador del CIIA, el propósito del proyecto es crear un sistema que ayude en la traducción del lenguaje de señas mexicano, mediante el uso de una cámara o sensor Kinect. A través de estos dispositivos, se obtienen nubes de puntos que son interpretadas por algoritmos de visión por computadora. De esta forma, las señas y gestos pueden ser traducidos a texto o voz.

En entrevista con la Agencia Informativa Conacyt, el investigador indicó que el proyecto contempla la creación de un traductor bidireccional, por lo que la investigadora de la Facultad de Ciencias de la Universidad Nacional Autónoma de México (UNAM), Ana Luisa González, trabaja en la animación de un avatar, capaz de realizar el lenguaje de señas.

“El objetivo es crear un sistema que funcione como un traductor bidireccional, con el reconocimiento de expresiones dinámicas del lenguaje de señas y la función de un avatar que emule el lenguaje de señas mexicano. Este sistema podría integrarse en lugares públicos como bancos u hospitales para facilitar la comunicación de personas con discapacidad auditiva”, explicó el doctor Vladimir Ríos.

“El objetivo es crear un sistema que funcione como un traductor bidireccional, con el reconocimiento de expresiones dinámicas del lenguaje de señas y la función de un avatar que emule el lenguaje de señas mexicano. Este sistema podría integrarse en lugares públicos como bancos u hospitales para facilitar la comunicación de personas con discapacidad auditiva”, explicó el doctor Vladimir Ríos.

La maestra de inteligencia artificial y becaria del Programa Nacional de Posgrados de Calidad (PNPC) del Consejo Nacional de Ciencia y Tecnología (Conacyt), Candy Obdulia Sosa Jiménez, trabaja también en el reconocimiento de expresiones dinámicas en el lenguaje de señas mexicano que, en conjunto con el trabajo de reconocimiento del alfabeto de señas elaborado por el doctor Vladimir Ríos, formarán parte del sistema de traducción bidireccional.

El investigador señaló que los avances registrados se ubican en la detección del alfabeto a través del dispositivo y la animación del avatar, y deben integrar más expresiones al sistema, pues el lenguaje de señas mexicano es muy amplio.

“Buscamos que el alfabeto pueda ser reconocido en condiciones ambientales y complejas, además de ampliar el vocabulario hasta que abarque todo el lenguaje y sea capaz de reconocerlo y ejecutarlo, lo cual podría tomar largo tiempo”.

El lenguaje de señas consiste en expresiones faciales y signos articulados por las manos que permite la comunicación de las personas con discapacidad auditiva. El investigador enfatizó su interés en hacer del sistema un medio de inclusión social que, en medida de lo posible, dé respuesta a las necesidades de este sector.

AUTOR: Dioreleytte Valis

FUENTE: AGENCIA INFORMATIVA CONACYT